- Futurs Imparfaits

- Posts

- L'illusion de la tech impartiale car démocratique 🪞🤖

L'illusion de la tech impartiale car démocratique 🪞🤖

Tout algorithme est biais !

Hier

À l’âge innocent où spam, trolls, fake news, doxing, harcèlement en ligne, n’avaient pas encore été inventés, internet promettait un espace libéré des “gatekeepers” ou des “gardiens du temple”.

Plus d’éditeur (et plus de parent ?!) pour décider ce qui peut se dire et se lire, plus personne pour nous empêcher de connaître gloire et succès. Via des mini-sites personnels (pas encore appelés blogs), nous pouvions nous permettre de dire à peu prés tout ce qui nous passait par la tête, en espérant que quelqu’un à l’autre bout de la planète daignerait signer nos “livres d’or”.

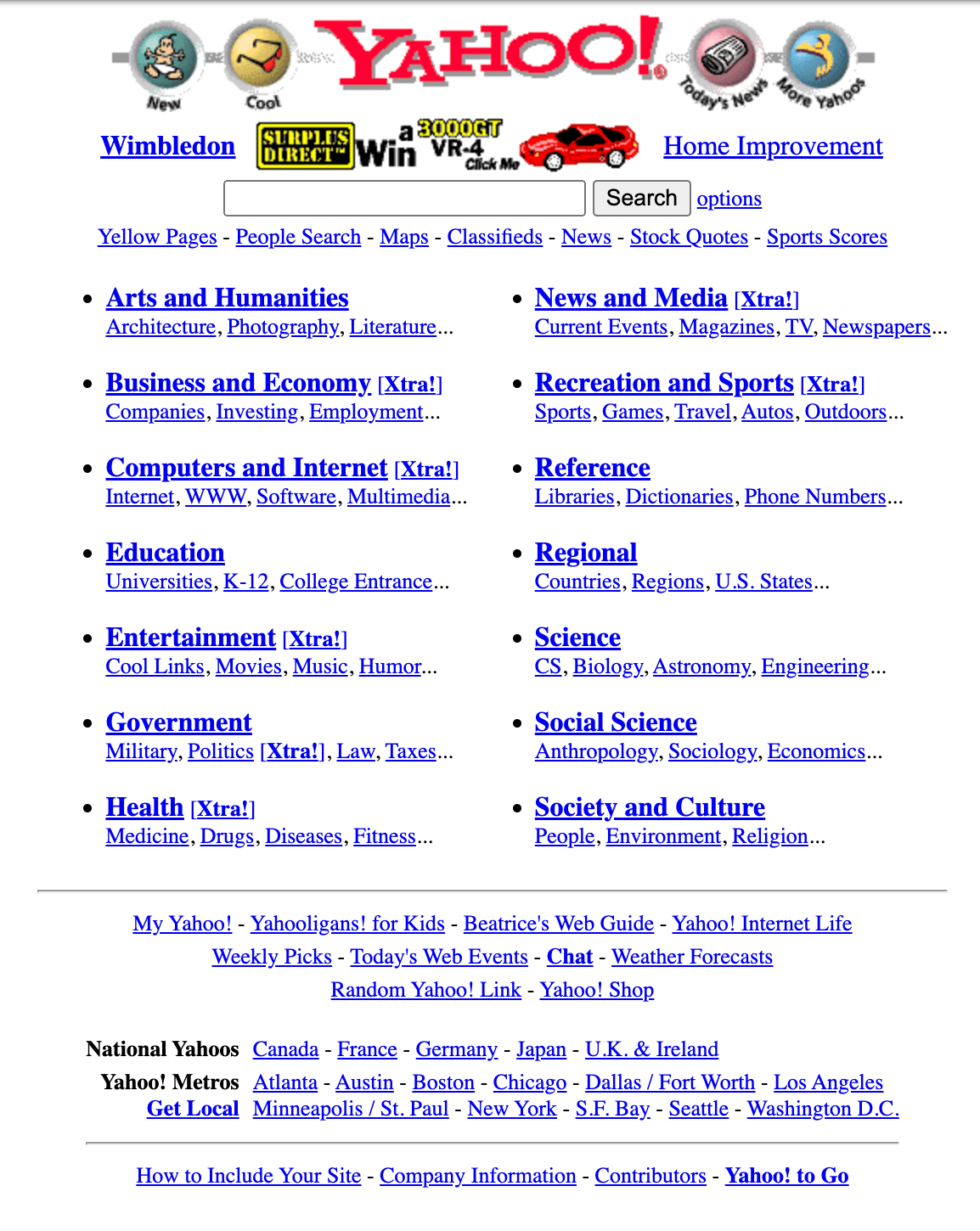

Bien rapidement, il a fallu s’équiper pour pouvoir naviguer dans un nombre croissant de sites et de contenus. Les premiers “portails” ont tenté une approche manuelle et éditorialisée : des hordes d’experts thématiques s’occupaient de lister les nouveautés du “cyberespace”, en proposant à leurs visiteurs une sélection qui n’était pas sans rappeler les magazines de l’ancien monde.

Yahoo en 1996, plus “portail” éditorialisé

que moteur de recherche automatisé

Google a bien entendu révolutionné le concept de recherche en ligne en automatisant le procédé (des “robots” qui s'occupaient d’explorer et de lister automatiquement tous les sites). Derrière sa homepage volontairement épurée, qui a été comprise comme une volonté de mettre en avant la simplicité du service, je pense qu’il y avait également cette volonté de suggérer que les gatekeepers ne reviendraient plus.

La froide logique de la machine nous libérerait des biais et de la partialité humaine pour garantir à chacun une chance démocratique d’émerger depuis cette masse presque illimitée.

Aujourd’hui

Bien sûr, les plateformes d’aujourd’hui ne sont pas au-dessus de tout soupçon.

On reproche constamment à Google sa position dominante. Mais ces attaques semblent très majoritairement se concentrer sur l’aspect économique (un monopole sur la publicité en ligne), plutôt que sur l’impartialité de son algorithme. Après tout, personne ne connait exactement les règles, et tout le monde est libre d’adapter son site pour tenter d’optimiser son classement.

De la même façon, on reproche à Facebook d’optimiser ses algorithmes pour nous rendre plus énervés ou inquiets, car il a été prouvé que ces émotions nous conduisent à passer plus de temps en ligne et donc à voir plus de publicités. Sous-entendu : il y a un état non-biaisé, et Facebook a trompé notre confiance en tentant de le manipuler pour en bénéficier.

Pour maintenir la paix numérique et leur situation de monopoles, il est capital pour les plateformes de laisser penser que si biais il y a, il ne peut être qu’humain.

Avant / pendant / après les élections américaines, des réseaux sociaux, accusés de favoritisme ou de censure, ont réagi en annonçant des coupes drastiques dans leurs équipes de modération (ou en les déménageant dans des territoires supposément moins “woke”) et en confiant à leurs communautés elles-mêmes le pouvoir d’étiqueter du contenu comme potentiellement faux ou trompeur.

Il y a donc un malentendu latent : parce que les algorithmes sont mathématiques par nature, parce que les données d’entrée suivent des règles démocratiques (tout créateur de contenu a la même connaissance des règles) et les règles d’évaluations sont elles-aussi démocratiques (un like, un clic, un commentaire montrant une marque d’intérêt), les résultats présentés sont d’une certaine façon “justes” et “vrais”. Tout ce que nous avons à faire pour avoir une vision objective du monde est de protéger la machine de toute influence ou intervention humaines et de nous prémunir de tout retour des gatekeepers qui nous imposeraient leurs vues.

Malheureusement, ces vues simplistes cachent une affreuse vérité :

Tout procédé qui permet de réduire l’infinie complexité de la vie à une liste contenue dans l’espace fini que sont nos écrans est un parti pris.

et donc : tout algorithme est biais.

On peut deviner aisément que des choix ont été faits pour nous par les algorithmes “boîtes noires” comme ceux des réseaux sociaux et de Google, qui s’occupent de définir selon leurs propres règles des concepts comme “pertinence”, “popularité” ou “intérêt” pour trier des contenus et décider de leur “viralité” et positions dans nos feeds ou résultats de recherche.

Mais le simple fait d’afficher du contenu sous une certaine forme (en vidéo ou en quelques lignes de texte) et de permettre de les évaluer d’une certaine façon (un like pouvant être émis de n’importe qui, indépendamment d’une quelconque qualité ou compétence) est un biais.

Quand nos feeds sont constitués de courtes vidéos marrantes, où n’importe qui peut envoyer des “coeurs” ou des “lol”, comment peut-on imaginer que des contenus de fond aient une chance d’émerger ?

Quand un restaurant est choisi sur la base de quelques photos et d’une évaluation provenant de n’importe qui, quelle chance a le petit boui-boui du coin de cuisine de grand-mère sans prétention aux plats pas sexy pour un sou mais tout de même excellents, face au nouveau concept de burgers/cocktails/ramens peruviano-coréano-californien ?

Prétendre que garantir un “libre marché” d’idées donne à chacun les mêmes chances d’émerger est au mieux naïf, et au pire le meilleur moyen de manipuler les masses en prétendant que le contenu qui émerge est neutre ou objectif sous prétexte qu’il est choisi par elles.

“Miroir magique au mur, quelle est ma note Uber ?”

Les plateformes nous ont ainsi affranchis des biais d’humains clairement identifiables, et nous ont imposé les leurs, peut-être plus dangereux car moins visibles. De cette confusion, découle un inversement des causes et des effets :

Ce n’est pas parce qu’un contenu est populaire qu’il devient viral.

C’est parce qu’il est viral qu’il devient populaire.

On nous encourage à penser que la victoire actuelle des idées populistes, voire simplistes, voire complètement fausses, signifie que les plateformes ont libéré la parole et nous ont permis de nous affranchir du carcan de la censure des bienpensants gatekeepers. C’est d’ailleurs l’argument préféré des stars des réseaux sociaux qui crient au scandale si les “médias traditionnels” ne leur donnent pas l’attention à laquelle elles pensent avoir droit.

Mais les idées du moment ne sont pas en vogue parce qu’elles sont populaires… elles sont en vogue parce qu’elles sont plus facilement partageables sur les réseaux !… et deviennent, ensuite, dans une sorte de réaction auto-réalisatrice, populaires.

Ce caractère auto-réalisateur nous conduit à penser que la machine nous révèle une vérité qui est d’une certaine façon plus objective et donc préférable (des contenus qui étaient auparavant censurés ou négligés mais dont la popularité a été révélée par un classement sans intervention humaine) alors que nous devrions plutôt réaliser que la machine force une autre vision du monde, différente de celles des gatekeepers mais peut-être pas préférable et certainement pas plus “Vraie”.

Et demain…

Malheureusement, demain ne semble pas vraiment plus ensoleillé qu’aujourd’hui.

Un milliardaire excité a récemment vendu la dernière version de son I.A. comme étant “maximally truth-seeking” (”recherchant furieusement la vérité” ?), sous prétexte que les résultats générés par l’impartiale machine ne seront pas censurés par de diaboliques humains “woke”.

S’il est admis que l’I.A. générative, par sa nature même, reproduit les biais de la donnée sur laquelle elle a été entrainée, cela n’empêche aucune startup de penser qu’un moteur de recherche utilisant cette technologie serait une bonne idée. La logique étant peut-être qu’un résumé des 10 premiers résultats de recherche qu’aurait donnés Google serait plus objectif et préférable que de ne lire qu’un seul des premiers résultats (?). Et donc en filigrane, encore une fois, de suggérer qu’une vérité peut émerger d’un algorithme.

Mais tout algorithme est un parti pris… aussi complexe ou basé sur la logique mathématique soit-il.

Un résumé est un parti pris. Choisir d’afficher une combinaison de mots parce qu’elle est statistiquement plus probable est un parti pris. Et empiler les biais (un moteur de résumé, sur un sous-segment biaisé fait de sources biaisées) ne rendra pas le tout plus objectif ou plus Vrai sous prétexte qu’il y a des formules mathématiques plus complexes à l’œuvre.

L’I.A. générative s’occupant de résumer le web pour nous pourrait devenir le parti pris ultime, d’autant plus dangereux qu’il sera plus invisible et incompris que jamais.

Un autre demain ?

Nous devons accepter l’impossibilité de l’objectivité, pour accepter la multitude de subjectivités. Permettre de choisir un algorithme c’est permettre de choisir sa vision du monde. Et pour cela, nous avons tout intérêt à préférer des outils qui nous laissent comprendre et moduler les biais qu’ils nous imposent :

Aujourd’hui | Demain ? |

|---|---|

Des algorithmes opaques, basés sur des critères non modifiables ou ajustables, afin de trier selon une “popularité” servant les intérêts de la plateforme. | Des algorithmes qui exposent autant que possible leurs biais et critères, qui permettent à leurs utilisateurs de jouer sur certaines variables de façon explicite et compréhensible (pas en bidouillant un prompt d’un chatbot) afin de définir eux-mêmes leur conception de popularité. |

Des signaux (like, commentaires) faibles et flous, devant être interprétés par la plateforme. | Des signaux complexes et qualifiés, permettant d’émettre des opinions subtiles sans besoin d’interprétation. |

Site indépendant ou institutionnel ? Local ou international ? À but lucratif ou non ? De mes réseaux d’amis ou de collèges ?… Une infinité de paramètres peuvent être imaginés pour reprendre le contrôle, au lieu de nous conforter dans l’impossible objectivité de la machine.

Illustration de la homepage Yahoo via web.archive.org

Reply